Les chatbots d’IA et la santé mentale des adolescents. Réflexions à partir du mémoire de master de Sophie Klose (Webster University)

Marcia Banks, Coordinatrice des publications anglaises, Le Pôle

Réflexions à partir du mémoire de master de Sophie Klose (Webster University, mai 2025), Analyse des chatbots d’IA en santé mentale dans des contextes de conseil simulés auprès d’adolescents et de jeunes adultes

C’est du point de vue d’une éducatrice, en s’appuyant à la fois sur la recherche et l’expérience vécue, que le mémoire de Sophie Klose trouve un écho particulier. Son travail examine l’efficacité des chatbots d’IA dans la prise en charge de la dépression, des idées suicidaires et de l’automutilation, et soulève des questions importantes pour les écoles et les professionnel·le·s de l’éducation, confronté·e·s de plus en plus à cette réalité.

Les taux d’anxiété, de dépression, d’automutilation et d’idéation suicidaire continuent d’augmenter à l’adolescence. Selon le mémoire de Sophie Klose, de nombreux jeunes se tournent vers les chatbots d’IA pour obtenir des conseils et un soutien émotionnel, souvent avant de solliciter l’aide d’un adulte de confiance. Cela n’a rien d’étonnant.

Une revue de l’Organisation mondiale de la santé (2024) indique qu’un enfant sur sept âgé de 10 à 19 ans vit avec un trouble mental, et que le suicide est la deuxième cause de mortalité chez les 10–19 ans en Europe. Les comportements d’automutilation apparaissent souvent dès 12 ou 13 ans. L’identification précoce et l’intervention rapide sont donc cruciales, car les adolescents ayant vécu un premier épisode de trouble dépressif majeur sont plus susceptibles de rencontrer des problèmes de santé mentale plus tard dans la vie.

Bien que Sophie Klose ne se concentre pas explicitement sur les écoles ou leur rôle dans l’identification précoce, il est clair que celles-ci se trouvent au cœur de cette réalité, puisque la vie des enfants et des adolescents s’y déroule en grande partie. Les problèmes de santé mentale ne se manifestent pas toujours comme des crises, mais plutôt par des changements progressifs : retrait, fatigue, irritabilité, ou variations dans l’engagement et les résultats scolaires. Les éducateurs et les professionnel·le·s travaillant en milieu scolaire ne sont pas des thérapeutes, mais ils sont souvent les premiers à remarquer que quelque chose ne va pas.

Les éducateurs sont conscients de l’importance de favoriser un sentiment d’appartenance et de connexion au sein de l’école, des facteurs de protection essentiels pour le bien-être des adolescents.

Pourquoi les adolescents se tournent vers les chatbots d’IA

L’IA fait désormais partie intégrante de la vie des enfants et des jeunes. Les élèves l’utilisent pour leurs travaux scolaires et, comme le suggère le mémoire de Sophie Klose, de plus en plus pour obtenir conseils et soutien émotionnel. L’IA est immédiatement accessible et répond rapidement et offre un espace de confidentialité. Il n’y a pas la crainte de décevoir quelqu’un, ni besoin de gérer la réaction émotionnelle d’autrui, ni incertitude sur le fait que ses préoccupations soient « suffisamment graves ».

La stigmatisation, la peur du jugement, les longues listes d’attente pour consulter un·e thérapeute ou un·e conseiller·ère, ainsi que l’incertitude sur la manière d’entamer une conversation sur ses sentiments peuvent décourager les adolescents de chercher de l’aide professionnelle. Dans ce contexte, l’IA devient une alternative attrayante.

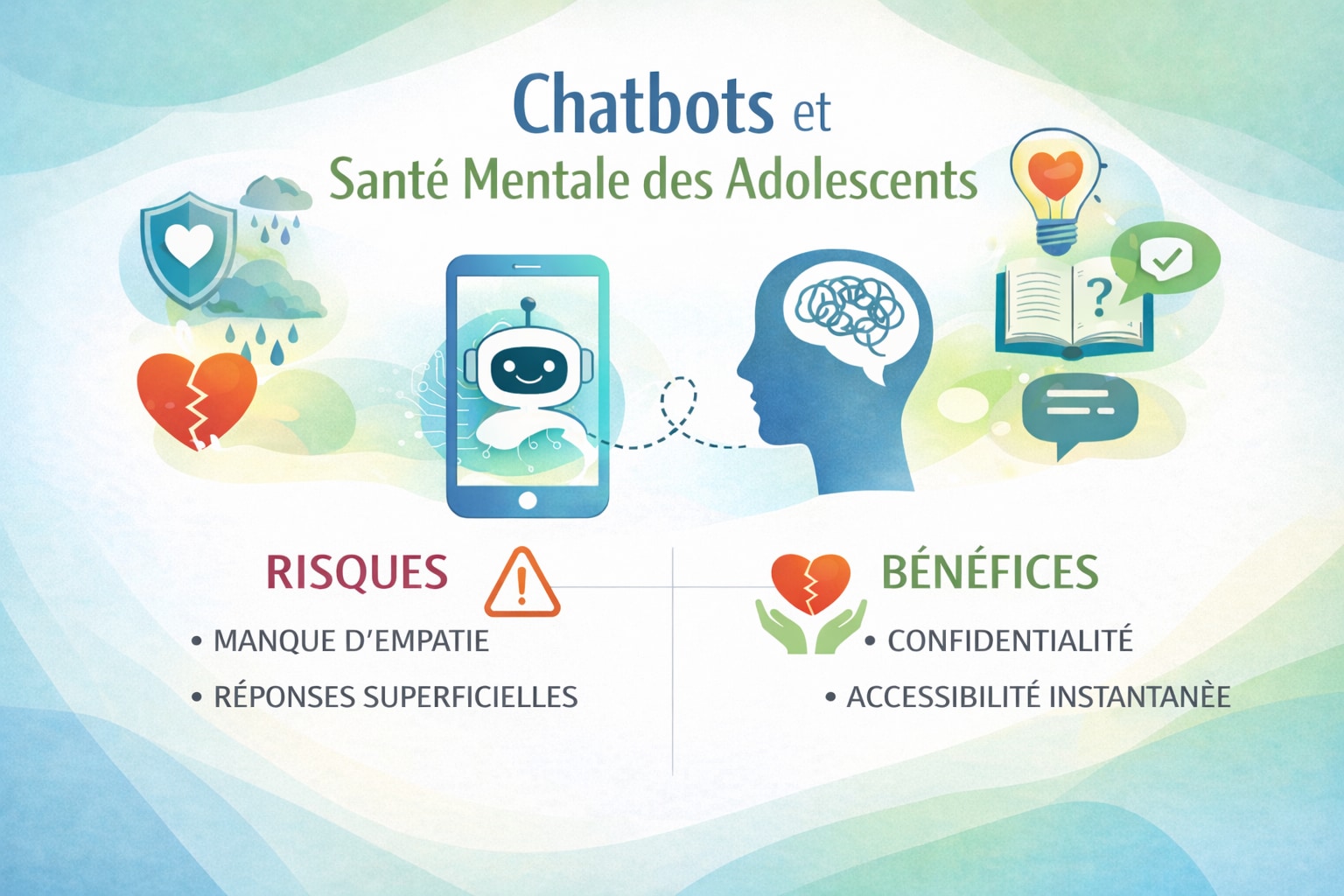

Les bénéfices potentiels des chatbots d’IA

Lorsqu’ils sont utilisés correctement et dans des limites claires, les chatbots d’IA peuvent offrir un soutien limité mais significatif. Ils peuvent fournir une psychoéducation sur la santé mentale, en identifiant certains troubles et leurs symptômes, proposant des orientations de traitement générales et des stratégies de gestion de base.

Les chatbots d’IA peuvent aussi aider certains jeunes à repérer les premiers signes de difficultés psychiques et à exprimer des préoccupations qu’ils n’osent pas partager avec un·e thérapeute ou un adulte de confiance. Pour certains, cela peut même constituer une première étape vers la recherche d’aide.

Cependant, comme le souligne Sophie Klose, ces outils ont des limites importantes.

Préoccupations et risques

- Absence de véritable empathie : Les chatbots peuvent simuler l’empathie, mais ne disposent pas de la capacité humaine d’ajustement empathique aux états émotionnels d’autrui, ni du jugement clinique, ni de l’expertise professionnelle.

- Réponses génériques : Les conseils proposés sont souvent larges et insuffisamment adaptés à des situations individuelles complexes, restant superficiels dans leur portée thérapeutique.

- Faux sentiment de soutien : Les adolescents peuvent se sentir temporairement « aidés » et retarder la recherche d’un soutien humain ou professionnel approprié.

- Sur-attachement et dépendance : La dépendance émotionnelle aux chatbots peut accroître l’isolement et réduire les interactions dans le monde réel. Comme le note Sophie Klose, ce risque est « particulièrement pertinent pour les adolescents qui sont, sur le plan développemental, plus vulnérables à former des attachements émotionnels intenses avec des agents relationnels » (p. 108).

- Illusion d’intimité : Un langage émotionnellement riche peut donner l’impression d’une relation authentique, ce qui représente un risque particulier pour les adolescents développementalement vulnérables.

L’utilisation d’outils d’IA à des fins de santé mentale comporte le risque de masquer la détresse plutôt que de la traiter. Les chatbots ne peuvent remplacer la profondeur, la réactivité et la complexité relationnelle du soutien humain. Cela conduit à la question posée par Sophie Klose :

« Favorisons-nous la guérison, ou conditionnons-nous les utilisateurs à rechercher des réponses fluides et constamment rassurantes, au risque d’affaiblir leur capacité à faire face aux frictions et exigences naturelles des relations humaines réelles ? » (p. 111)

Les facteurs de protection les plus efficaces pour les jeunes restent inchangés : des relations de confiance, un sentiment d’appartenance, des adultes attentifs et un soutien apporté en temps utile.

À mesure que les technologies numériques continuent d’évoluer, les écoles doivent rester réfléchies et ancrées dans leurs valeurs. L’IA peut être un outil d’appui, mais elle ne remplacera jamais la présence, l’empathie et la profondeur relationnelle dont les adolescents ont fondamentalement besoin. En tant qu’éducateurs, nous savons que ce qui transforme réellement la vie des jeunes n’est ni la perfection ni l’affirmation constante, mais la présence, la patience et la relation. Les programmes favorisant la collaboration, la créativité, l’agentivité et la connexion — comme les arts, les initiatives de résolution de problèmes et les programmes d’apprentissage créatif — constituent des soutiens puissants pour la santé mentale et le bien-être.

Le mémoire de Sophie Klose met en lumière à la fois le potentiel et les limites des chatbots d’IA dans le domaine de la santé mentale des adolescents. L’IA peut offrir un point d’entrée pour les jeunes qui ne sont pas encore prêts à s’adresser à un adulte. Toutefois, la guérison se produit lorsque les élèves se sentent vus, pris au sérieux et soutenus par des personnes qui remarquent — et qui restent.